本記事3行要約:

● 投稿論文数は15,671件、採択件数は4,037件に!

● 日本人からの研究は採択件数4,037件中 111件!過去4年で最小値2.75%!

● 出現キーワードではDiffusion、Language Model の2テーマで全体の15%近くを占める!

半年ほど前に開催されたNeurIPSですが、これまで毎年定点観測しておりましたので、[NeurIPS 2024]を振り返る意味でも統計など簡潔にまとめました。

過去の記事では、NeurIPSというカンファレンスの由来や始まりについてまとめておりますので、そちらも参考にしてみてください。なお、本記事についても前回同様、数値データを中心にコンパクトに統計などをまとめております。

*参照:

「NeurIPS」ResearchPortトップカンファレンス定点観測 vol.2

「NeurIPS 2022」ResearchPortトップカンファレンス定点観測 vol.8

「NeurIPS 2023」ResearchPortトップカンファレンス定点観測 vol.14

NeurIPS 2024 開催概要

▶ 開催期間: 10 – 15 Dec., 2024

▶ 開催都市: Vancouver, CANADA

▶ 公式HP: https://neurips.cc/Conferences/2024

■NeurIPS 2024総括

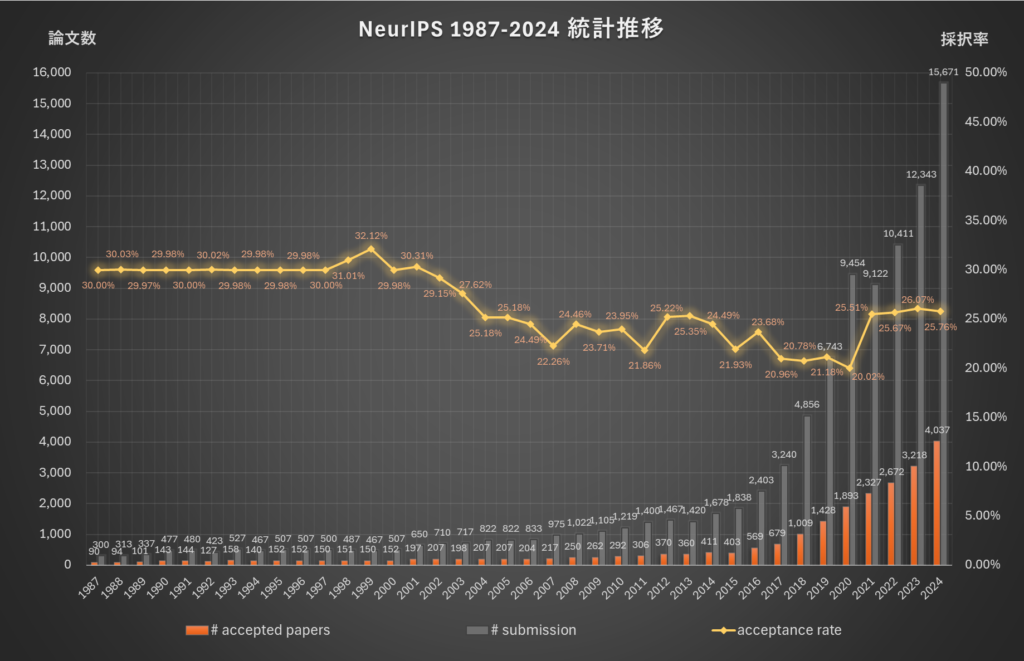

まず最初に投稿数・採択率の推移を見ていきます(表1・図1)。

論文投稿数は、前回会議と比較して3,000件以上増え、15,671件(メイン会議)となりました。採択率も25.76%で、量が増えても依然として高難易度な会議です。

NeurIPS公式の発表によると、登録者数も計19,756名(対面16,777名/オンライン2,978名)とあり、おそらくAI関連学会では最多となる規模ではないでしょうか。このあたりからも相変わらずの盛況感が伺えます。

| conferences | Year | # submission | # accepted papers | acceptance rate | Country | Venue |

|---|---|---|---|---|---|---|

| NeurIPS | 1987 | 300 | 90 | 30.00% | USA | Denver |

| NeurIPS | 1988 | 313 | 94 | 30.03% | USA | Denver |

| NeurIPS | 1989 | 337 | 101 | 29.97% | USA | Denver |

| NeurIPS | 1990 | 477 | 143 | 29.98% | USA | Denver |

| NeurIPS | 1991 | 480 | 144 | 30.00% | USA | Denver |

| NeurIPS | 1992 | 423 | 127 | 30.02% | USA | Denver |

| NeurIPS | 1993 | 527 | 158 | 29.98% | USA | Denver |

| NeurIPS | 1994 | 467 | 140 | 29.98% | USA | Denver |

| NeurIPS | 1995 | 507 | 152 | 29.98% | USA | Denver |

| NeurIPS | 1996 | 507 | 152 | 29.98% | USA | Denver |

| NeurIPS | 1997 | 500 | 150 | 30.00% | USA | Denver |

| NeurIPS | 1998 | 487 | 151 | 31.01% | USA | Denver |

| NeurIPS | 1999 | 467 | 150 | 32.12% | USA | Denver |

| NeurIPS | 2000 | 507 | 152 | 29.98% | USA | Denver |

| NeurIPS | 2001 | 650 | 197 | 30.31% | Canada | Vancouver |

| NeurIPS | 2002 | 710 | 207 | 29.15% | Canada | Vancouver |

| NeurIPS | 2003 | 717 | 198 | 27.62% | Canada | Vancouver |

| NeurIPS | 2004 | 822 | 207 | 25.18% | Canada | Vancouver |

| NeurIPS | 2005 | 822 | 207 | 25.18% | Canada | Vancouver |

| NeurIPS | 2006 | 833 | 204 | 24.49% | Canada | Vancouver |

| NeurIPS | 2007 | 975 | 217 | 22.26% | Canada | Vancouver |

| NeurIPS | 2008 | 1,022 | 250 | 24.46% | Canada | Vancouver |

| NeurIPS | 2009 | 1,105 | 262 | 23.71% | Canada | Vancouver |

| NeurIPS | 2010 | 1,219 | 292 | 23.95% | Canada | Vancouver |

| NeurIPS | 2011 | 1,400 | 306 | 21.86% | Spain | Granada |

| NeurIPS | 2012 | 1,467 | 370 | 25.22% | USA | Lake Tahoe |

| NeurIPS | 2013 | 1,420 | 360 | 25.35% | USA | Lake Tahoe |

| NeurIPS | 2014 | 1,678 | 411 | 24.49% | Canada | Montreal |

| NeurIPS | 2015 | 1,838 | 403 | 21.93% | Canada | Montreal |

| NeurIPS | 2016 | 2,403 | 569 | 23.68% | Spain | Barcelona |

| NeurIPS | 2017 | 3,240 | 679 | 20.96% | USA | Longbeach |

| NeurIPS | 2018 | 4,856 | 1,009 | 20.78% | Canada | Montréal |

| NeurIPS | 2019 | 6,743 | 1,428 | 21.18% | USA | Vancouver |

| NeurIPS | 2020 | 9,454 | 1,893 | 20.02% | Canada | Vancouver |

| NeurIPS | 2021 | 9,122 | 2,327 | 25.51% | – | Online |

| NeurIPS | 2022 | 10,411 | 2,672 | 25.67% | USA | New Orleans |

| NeurIPS | 2023 | 12,343 | 3,218 | 26.07% | USA | New Orleans |

| NeurIPS | 2024 | 15,671 | 4,037 | 25.76% | Canada | Vancouver |

表1 NeurIPS論文投稿数および採択率

*補足*

赤地の部分は採択率を類推しています。黄地の部分は統計に情報にばらつきあり信頼性が低い可能性があります。論文集・その他を、プログラムを書きながら解析した部分もあるので、一部別のウェブサイトで報告されている件数などと多少の差がある可能性があります。

*補足2*

2021 の数値については、公式には2,327件および2,344件との報告がありますが、proceedingsのサイトおよびOpenReviewのサイトに収録されている件数に違いがあり、いずれが正しいのか分かりません。このため以降の記述においてはOpenReviewサイトを基準といたします。2022も同様です。

■日本人研究者別-論文採択数

本カンファレンスでも、日本人著者に限定してその活躍も調べておりますので、下記に示します。

まずは早速、NeurIPS 2024個人別採択件数ランキングをご覧ください。(図2)

| 著者 | 採択数 |

|---|---|

| Taiji Suzuki |

6

|

| Masashi Sugiyama |

5

|

| Kenji Kawaguchi |

4

|

| Kazuki Irie |

3

|

| Shinji Ito |

3

|

| Tatsunori Hashimoto |

3

|

| Akifumi Wachi |

2

|

| Akiko Takeda |

2

|

| Atsushi Nitanda |

2

|

| Atsutoshi Kumagai |

2

|

| Hiroshi Kera |

2

|

| Kazusato Oko |

2

|

| Makoto Yamada |

2

|

| Masahiro Fujisawa |

2

|

| Masaki Adachi |

2

|

| Michihiro Yasunaga |

2

|

| Naoki Murata |

2

|

| Shinichi Nakajima |

2

|

| Shinsaku Sakaue |

2

|

| Taihei Oki |

2

|

| Taira Tsuchiya |

2

|

| Taisuke Yasuda |

2

|

| Tomoharu Iwata |

2

|

| Toshihiko Yamasaki |

2

|

| Yasuhiro Fujiwara |

2

|

| Yuki Mitsufuji |

2

|

| Akari Asai |

1

|

| Akiko Manada |

1

|

| Akio Kodaira |

1

|

| Akiyuki Anzai |

1

|

| Atsuki Yamaguchi |

1

|

| Daiki Kimura |

1

|

| Futoshi Futami |

1

|

| Gaku Morio |

1

|

| Genki Osada |

1

|

| Go Irie |

1

|

| Go Nagahara |

1

|

| Gouki Minegishi |

1

|

| Hidenori Tanaka |

1

|

| Hidetoshi Shimodaira |

1

|

| Hikaru Shindo |

1

|

| Hiroki Furuta |

1

|

| Hiroshi Takahashi |

1

|

| Hiroto Kurita |

1

|

| Hisashi Kashima |

1

|

| Kaito Ito |

1

|

| Kaoru Sezaki |

1

|

| Kashu Yamazaki |

1

|

| Kazuhiro Yokoyama |

1

|

| Kazuki Egashira |

1

|

| Kazuki Kozuka |

1

|

| Kazumi Fukuda |

1

|

| Kazumune Hashimoto |

1

|

| Kazushi Ikeda |

1

|

| Kazutoshi Yamazaki |

1

|

| Kenji Kashima |

1

|

| Keno Harada |

1

|

| Kenta Niwa |

1

|

| Kiyohiro Nakayama |

1

|

| Ko Nishino |

1

|

| Kohei Miyaguchi |

1

|

| Kohei Watabe |

1

|

| Koichiro Niinuma |

1

|

| Kosuke Nakatani |

1

|

| Makoto Onizuka |

1

|

| Makoto Takamoto |

1

|

| Manabu Okumura |

1

|

| Masahiro Suzuki |

1

|

| Masahiro Yoshida |

1

|

| Masahito Uwamichi |

1

|

| Masatoshi Uehara |

1

|

| Masayoshi Tomizuka |

1

|

| Maya Okawa |

1

|

| Naoki Hiratani |

1

|

| Noboru Koshizuka |

1

|

| Rei Sato |

1

|

| Ryoma Sato |

1

|

| Ryoma Yataka |

1

|

| Ryosuke Shibasaki |

1

|

| Ryuhei Takahashi |

1

|

| Ryumei Nakada |

1

|

| Satoshi Sawai |

1

|

| Seijin Kobayashi |

1

|

| Sekitoshi Kanai |

1

|

| Shinya Suzumura |

1

|

| Sho Yokoi |

1

|

| Shogo Iwazaki |

1

|

| Shohei Kato |

1

|

| Shohei Taniguchi |

1

|

| Shota Saito |

1

|

| Soichiro Kumano |

1

|

| Tadanobu Inoue |

1

|

| Tadashi Kozuno |

1

|

| Tai Nakamaki |

1

|

| Taiki Miyagawa |

1

|

| Taishi Nishiyama |

1

|

| Takanori Maehara |

1

|

| Takashi Furuya |

1

|

| Takashi Maruyama |

1

|

| Takashi Nishide |

1

|

| Takashi Shibata |

1

|

| Takashi Shibuya |

1

|

| Takayuki Katsuki |

1

|

| Takayuki Osogami |

1

|

| Takeo Watanabe |

1

|

| Takeru Yokota |

1

|

| Takeshi Koshizuka |

1

|

| Takeshi Noda |

1

|

| Takumi Tanabe |

1

|

| Takuo Matsubara |

1

|

| Takuya Ito |

1

|

| Takuya Narihira |

1

|

| Taro Makino |

1

|

| Taro Toyoizumi |

1

|

| Tatsuya Harada |

1

|

| Terufumi Morishita |

1

|

| Tomoshi Iiyama |

1

|

| Tomoya Sakai |

1

|

| Tomoyoshi Kimura |

1

|

| Toshimitsu Uesaka |

1

|

| Yasuhiro Sogawa |

1

|

| Yasuhisa Fujii |

1

|

| Yasutoshi Ida |

1

|

| Youhei Akimoto |

1

|

| Yuki Kawamura |

1

|

| Yuki Minai |

1

|

| Yuki Takezawa |

1

|

| Yuko Kuroki |

1

|

| Yuma Ichikawa |

1

|

| Yuma Takeda |

1

|

| Yusuke Iwasawa |

1

|

| Yusuke Kato |

1

|

| Yusuke Kuwana |

1

|

| Yusuke Tanaka |

1

|

| Yuta Goto |

1

|

| Yuta Oshima |

1

|

図2 NeurIPS 2024 個人別採択件数ランキング

*OpenReview、Proceedingsで掲載されている論文数に違いがありますので、ここではOpenReviewに掲載されている論文を基に集計しています。

2024年の論文内で日本人らしい著者(海外で活躍する研究者も含む)が含まれる論文タイトルの件数は、2022年:81件 → 2023年:104件 → 2024年:111件と微増という結果でした。採択論文全体に占める件数割合は2.75%と3%を下回る結果となっております。

累積ランキングは、2021-2024年(OpenReviewに論文掲載がある)をまとめております。(図3)

本年度も、2件以上の採択実績を持つ方のみを掲載しております。

昨年のデータに今年度分が上乗せされておりますので、大きなランキング変動などは見受けられません。

日本人著者ランキング

| 著者 | 採択数 |

|---|---|

| Masashi Sugiyama |

23

|

| Kenji Kawaguchi |

19

|

| Taiji Suzuki |

17

|

| Shinji Ito |

11

|

| Tatsunori Hashimoto |

10

|

| Atsushi Nitanda |

8

|

| Tomoharu Iwata |

7

|

| Seijin Kobayashi |

7

|

| Atsutoshi Kumagai |

7

|

| Shinsaku Sakaue |

7

|

| Kazuki Irie |

6

|

| Taihei Oki |

6

|

| Makoto Yamada |

6

|

| Yasuhiro Fujiwara |

5

|

| Tadashi Kozuno |

5

|

| Hidenori Tanaka |

5

|

| Masayoshi Tomizuka |

5

|

| Taira Tsuchiya |

5

|

| Masatoshi Uehara |

5

|

| Yasutoshi Ida |

4

|

| Yusuke Iwasawa |

4

|

| Shinichi Nakajima |

4

|

| Akiko Takeda |

4

|

| Akifumi Wachi |

4

|

| Toshihiko Yamasaki |

4

|

| Michihiro Yasunaga |

4

|

| Masaki Adachi |

3

|

| Daiki Chijiwa |

3

|

| Masahiro Fujisawa |

3

|

| Kenji Fukumizu |

3

|

| Yasutaka Furukawa |

3

|

| Futoshi Futami |

3

|

| Tatsuya Harada |

3

|

| Junya Honda |

3

|

| Shogo Iwazaki |

3

|

| Hiroshi Kera |

3

|

| Kohei Miyaguchi |

3

|

| Kazusato Oko |

3

|

| Naoya Takeishi |

3

|

| Naonori Ueda |

3

|

| Shin’ya Yamaguchi |

3

|

| Taisuke Yasuda |

3

|

| Youhei Akimoto |

2

|

| Akari Asai |

2

|

| Hajime Asama |

2

|

| Yuki Asano |

2

|

| Kazuto Fukuchi |

2

|

| Hiroki Furuta |

2

|

| Takashi Furuya |

2

|

| Kazumune Hashimoto |

2

|

| Satoshi Hayakawa |

2

|

| Naoki Hiratani |

2

|

| Masahiro Ikeda |

2

|

| Go Irie |

2

|

| Takuya Ito |

2

|

| Heishiro Kanagawa |

2

|

| Sekitoshi Kanai |

2

|

| Hisashi Kashima |

2

|

| Yusuke Kato |

2

|

| Takayuki Katsuki |

2

|

| Koki Kawabata |

2

|

| Yoshinobu Kawahara |

2

|

| Tomoyoshi Kimura |

2

|

| Sadamori Kojaku |

2

|

| Kazuki Kozuka |

2

|

| Soichiro Kumano |

2

|

| Yuko Kuroki |

2

|

| Takanori Maehara |

2

|

| Taro Makino |

2

|

| Takashi Maruyama |

2

|

| Takashi Matsubara |

2

|

| Yuki Mitsufuji |

2

|

| Taiki Miyagawa |

2

|

| Naoki Murata |

2

|

| Kengo Nakamura |

2

|

| Kiyohiro Nakayama |

2

|

| Naoki Nishikawa |

2

|

| Kenta Niwa |

2

|

| Maya Okawa |

2

|

| Manabu Okumura |

2

|

| Jun Sakuma |

2

|

| Rei Sato |

2

|

| Ryoma Sato |

2

|

| Yoichi Sato |

2

|

| Takuma Seno |

2

|

| Hikaru Shindo |

2

|

| Sho Sonoda |

2

|

| Mahito Sugiyama |

2

|

| Kei Takemura |

2

|

| Yuki Takezawa |

2

|

| Takumi Tanabe |

2

|

| Yusuke Tanaka |

2

|

| Shohei Taniguchi |

2

|

| Hiroyuki Toda |

2

|

| Ryota Tomioka |

2

|

| Daisuke Urano |

2

|

| Takaharu Yaguchi |

2

|

| Kenji Yamanishi |

2

|

| Atsushi Yamashita |

2

|

| Ryoma Yataka |

2

|

| Yuichi Yoshida |

2

|

図3 NeurIPS 2021-2024 日本人著者ランキング

■トレンドキーワードの推移

今回もキーワードトレンドについてまとめてみました(表2)。

これまで同様“Diffusion(拡散モデル)”の強さが際立っていることと、”Large Language Model(LLM)”も双璧を成す存在です。マルチモーダル化の進展も見られるキーワードランキングになっております。

昨年NeurIPS 2023では、生成AIを象徴する“Diffusion”が大きく数字を伸ばしました。今年はさらに“Diffusion”の出現率が上がり7.41%です。引き続き生成AIの深化はトレンドと言えるのではないでしょうか。また、大規模言語モデル(Large Language Model;LLM)も昨年同様、全体トップをキープしており、この2つのキーワードだけで、全体の15%近くを占めています。

NeurIPS 2024では、生成AIの研究において、LLMがスタンダードなツールになっていることが読み取れます。テキストを入力とするDiffusion Modelや、マルチモーダルモデルと言語モデルの融合など実応用を意識したテーマが顕著になっています。

これまでのDiffusion優勢のトレンドから、LLM関連がさらに存在感を強くしていくことが予想されます。また大規模な生成モデルを扱うため、モデルの効率化・高速化の必要性も高まっています。

生成AIのトレンドは変わらず、効率性・省リソース化、マルチモーダルの進展、社会実装を見据えたエージェントAIへの進化、このあたりがNeurIPS 2024のトレンドとして挙げられるのではないでしょうか。

表2 論文出現キーワード推移(2024-2021年)

* 前回より、出現キーワードの抽出方法を変更いたしました。

過去に公開したコラム内の出現キーワードとの順位相違や、新たなキーワードが追加されております。

■まとめ

以上のように、簡易的に重要指標から考察してまいりました。

NeurIPS 2024終了後、本記事公開までお時間要してしまいましたが、振り返り的な位置付けでご覧いただければありがたいです。

データ解析・公開にあたっては細心の注意を払っておりますが、万が一、間違いなどございましたら遠慮なく弊社までご連絡ください。

編集:ResearchPort事業部

■Contact

本記事に関する質問や、ご意見・ご要望などがございましたらResearchPortまでお問い合わせください。

https://research-p.com/contactform/

-

2026年4月23日

「ICLR 2026」ResearchPortトップカンファレンス定点観測 vol.21